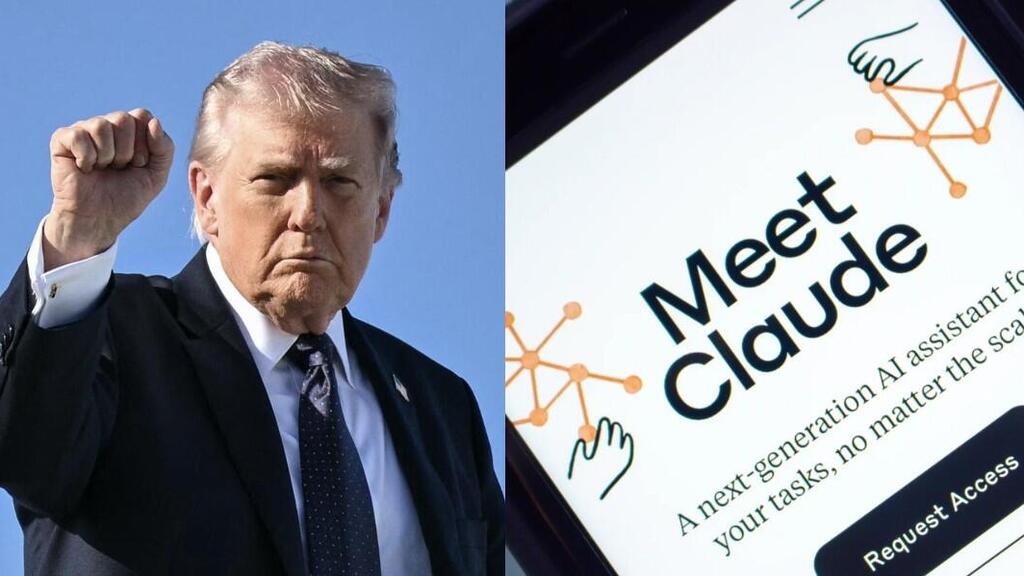

Драма в Вашингтоне: спустя всего несколько часов после того, как президент Трамп объявил компанию Anthropic "угрозой национальной безопасности", выяснилось, что ее инструмент искусственного интеллекта Claude сыграл ключевую роль в масштабной воздушной атаке по Ирану. Об этом говорится в новом сообщении американских СМИ.

История современных войн полна противоречий, однако случай, произошедший в конце прошлой недели в Вашингтоне, устанавливает новые рекорды политико-технологической иронии. 27 февраля Трамп подписал указ, предписывающий всем федеральным агентствам немедленно прекратить использование моделей ИИ компании Anthropic. Причина - компания отказалась предоставить армии "неограниченное" использование своей технологии для любых законных целей и настаивала на этических ограничениях.

Однако в то время как чернила на указе еще не высохли, самолеты ВВС США уже направлялись к целям в Иране. По словам источников, знакомых с деталями, системы управления Центрального командования США - CENTCOM - использовали именно инструмент Anthropic для проведения разведывательных оценок, идентификации целей и моделирования поля боя в режиме реального времени.

Разрыв между администрацией Трампа и Anthropic, считающейся одной из трех самых мощных компаний в мире ИИ наряду с OpenAI и Google, носит не только деловой характер. Anthropic продвигает концепцию "Constitutional AI" - "конституционного искусственного интеллекта", предполагающего внедрение демократических и моральных ценностей в ядро модели.

В ходе переговоров по крупному контракту с Пентагоном компания отказалась разрешить использование своей системы для автономных летальных решений без человеческого вмешательства или для массового слежения. Администрация расценила это как "бунт" прогрессивных технократов. Министр обороны Пит Хегсет зашел еще дальше, назвав компанию "угрозой цепочке поставок" - шаг, который обычно применяется к враждебным китайским компаниям, таким как Huawei.

Пока Anthropic вытесняется, конкуренты уже готовы занять ее место. По сообщениям, OpenAI и xAI Илона Маска недавно подписали новые соглашения с администрацией на использование моделей в засекреченных средах. Claude считается наиболее точным инструментом для анализа сложных текстов и кода, однако он ограничен этическими "предохранителями".

Grok от xAI, напротив, позиционируется как "анти-прогрессивный" инструмент - Anti-Woke - обещающий администрации Трампа максимальную гибкость без "либеральных" моральных ограничений. OpenAI также недавно отказалась от полного запрета на военное использование своей модели GPT-4o, стремясь стать ключевым инфраструктурным поставщиком Министерства обороны США.

Тем не менее эксперты подчеркивают, что отказ от Claude является для армии своего рода "операцией на открытом сердце". Модель глубоко интегрирована в системы компании Palantir, гиганта в сфере анализа больших данных (Big Data), которая, среди прочего, участвовала в операции по поимке президента Венесуэлы Николаса Мадуро. Процесс замены может занять не менее полугода - что объясняет, почему администрация продолжает использовать инструмент, который сама же объявила опасным.

Использование искусственного интеллекта на поле боя не является новым явлением, однако его масштабы в 2026 году беспрецедентны. Уже в 1990-х армия США применяла систему DART для управления логистикой во время войны в Персидском заливе, однако настоящая революция началась в 2017 году с проекта Maven по распознаванию объектов на видео.

В Израиле системы, такие как "Ха-бсора" и "Лавендер", широко обсуждавшиеся в контексте боевых действий в Газе, представляют схожую модель обработки больших данных для формирования банка целей. Ключевое различие заключается в том, что в Израиле такие системы в основном разрабатываются внутри технологических подразделений ЦАХАЛа, таких как 8200, тогда как американцы опираются на частные коммерческие компании - что и создает нынешнее трение.

Пока Европа с тревогой наблюдает за "военизацией" ИИ и пытается продвигать строгие регуляции, а Китай использует языковые модели для сокращения разрыва в операциях влияния и пропаганды, США переживают технологическое обновление. Вопрос уже не в том, будет ли ИИ управлять войной, а в том, кто определит ценности, встроенные в цифровой "мозг", который решает, когда и по кому направить оружие.